* tensor의 계산 (pytorch)

1. 흑백이미지의 y축 대칭 (좌우로 대칭이동) 이미지행렬 * 단위행렬의 반대각 행렬

2. 흑백이미지의 상하로 대칭 단위행렬의 반대각 행렬 * 이미지행렬

* mean vector and Covariance Matrix : PCA

평균벡터의이해

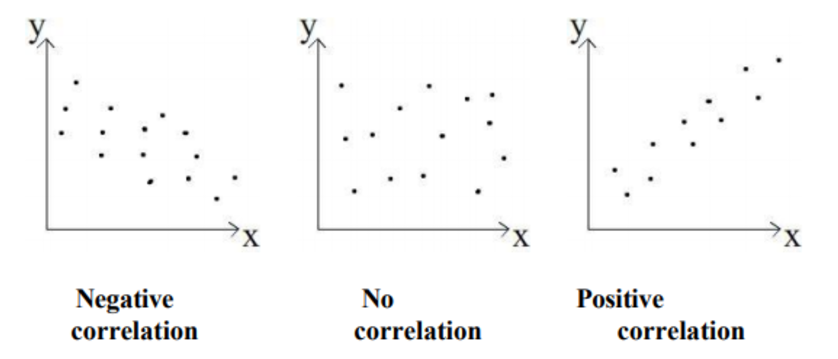

공분산 행렬: 여러 변수들의 공분산을 행렬 형태로 표현할한 것을 의미함

공분산이란 두 확률 변수 간의 선형 관계를 나타내는 지표로, 두 변수의 값이 함께 변화하는 정도를 측정

다변량 정규분포에서 각 변수 간의 분산과 공분산을 설명하느데 사용됨

공분산 행렬은 주성분 분석(PCA)에서 데이터의 주성분을 추출하는 데 사용됨

** How to get covariance matrix?

2.Random Variable

확률변수란?

1.확률적 시행의 결과(사건)를 실수로 대응시키는 함수이다.

2. 확률함수란 확률변수가 특정 값을 가질 확률을 나타내는 함수이다

3. 확률변수의 평균 = 기댓값

4. 확률변수의 분산은 기댓값의 특성을 나타내는 값

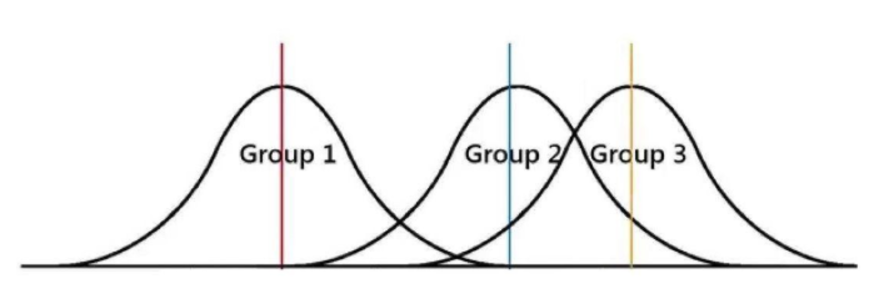

3. 분산분석

3개 이상 다수의 집단을 비교할 때 사용하는 가설검정 방법

H0 : 모든 집단의 평균은 같다. VS. H1 : 적어도 한 집단의 평균은 다르다.

** p < 0.05인 경우 H0(귀무가설) 기각

4. 상관분석

-5. ML/DL

** loss function

** gradient descent : loss function의 최솟값

How to get the derivatives of the logistic cost/loss function [TEACHING STAFF]

Hi! If you’re wondering how to get the derivatives for the logistic cost / loss function shown in course 1 week 3 “Gradient descent implementation”: I made a Google Colab (includes videos and code) that explains how to get these equations. (hold Ctrl

community.deeplearning.ai

loss function 식을 활용하여 gradient descent 까지 도출되는 과정으로 참고하면 좋을 사이트이다.

'Upstage AI Lab 6기' 카테고리의 다른 글

| 프로젝트를 위한 협업 : Github (1) | 2024.12.16 |

|---|---|

| 컴퓨터 공학 개론 (2) | 2024.12.11 |

| 프로젝트 수행을 위한 이론 2 : Python 모듈 학습 (0) | 2024.11.26 |

| Data Scientist 마인드셋 특강 학습블로그 (1) | 2024.11.19 |

| Upstage AI Lab 6기 OT 후기와 앞으로의 다짐 (0) | 2024.11.19 |